中学校で児童の生成ポルノが拡散 現行法では泣き寝入りも…急増する“フェイクポルノ”の実態

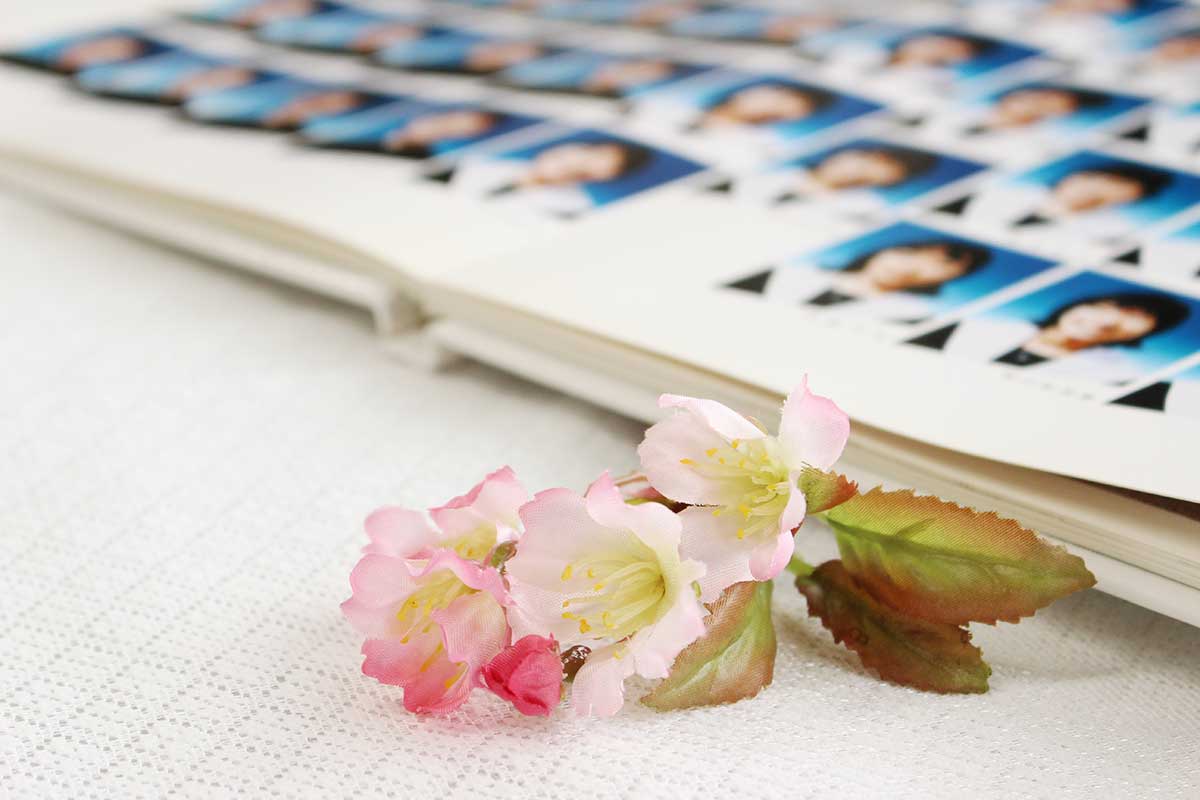

生成AIの普及に伴い、個人の写真をもとにポルノ画像や動画を生成するフェイクポルノの被害が急増している。中には卒業アルバムから生成したポルノ画像をネット上に公開されたり、いじめや脅迫、実際の性犯罪に発展するケースも……。急速に発展する生成AIに対し、どう向き合うべきなのか。法的な問題点にも詳しい民間ネットパトロール「ひいらぎネット」の永守すみれ代表に、複雑化する被害の実態を聞いた。

個人情報とともに加工したヌード画像を公開 「レイプしてください」など性犯罪をあおる投稿も

生成AIの普及に伴い、個人の写真をもとにポルノ画像や動画を生成するフェイクポルノの被害が急増している。中には卒業アルバムから生成したポルノ画像をネット上に公開されたり、いじめや脅迫、実際の性犯罪に発展するケースも……。急速に発展する生成AIに対し、どう向き合うべきなのか。法的な問題点にも詳しい民間ネットパトロール「ひいらぎネット」の永守すみれ代表に、複雑化する被害の実態を聞いた。(取材・文=佐藤佑輔)

自身も娘を育てる永守さんは、ネット上にまん延するデジタル性被害への懸念から、2020年、個人で不適切な画像や動画の通報活動を開始。翌年に有志のメンバーと「ひいらぎネット」を立ち上げ、被害者からの相談を受けるなど、幅広い活動を行っている。

先月中旬、永守さんらはある公立中学校の生徒のフェイクポルノがサーバー上に大量に投稿されていることを発見。このサーバーには1500人以上が参加しており、参加者は誰でも画像を保存できる状況にあったという。投稿には生徒の名前がフルネームで公開されており、被害児童は20人以上にものぼる。

「本名や学校、住所などの個人情報とともに生成したヌード画像を公開し、『レイプしてください』など性犯罪をあおる内容の投稿です。関係者しかアクセスできない学校行事の写真を素材にしており、同級生による行為の可能性が極めて高いと感じました。学校内で起こった問題の場合、明らかな犯罪行為でない以上警察はなかなか動けない。本件も学校側から警察に相談を行っていますが、現時点での対応は教員による全体指導とサーバーへの削除依頼のみ。学校側としても初めての事例で、対応に頭を悩ませています」

他人の写真を勝手に加工したり、個人情報をネット上で公開する行為は罪に問われることはないのだろうか。

「肖像権の侵害は民事訴訟扱いで、開示請求には1件20~30万円の費用がかかり、そもそも未成年が自ら訴訟を起こすことはできません。名誉棄損も親告罪で、現状は当事者が訴えを起こさなければ取り締まることはできない。フェイクポルノはクローズドなプラットフォームで拡散される場合が多く、被害者が拡散当初から被害に気付くことは難しい。性的好奇心を持った第三者や、リアルの知り合いから指摘され、初めて被害の実態に気付く場合がほとんどで、気付いたときにはかなりの範囲に画像が拡散しているという状況です。

芸能人のフェイクポルノ被害は警察も検挙に積極的ですが、一般人で立件されたケースは私の知る限り前例がありません。また、投稿に『コラージュ画像です』などの記載があると、名誉棄損の成立要件となる事実の摘示に当たらなかったり、身体部分が生成された画像だと児童ポルノには当たらないと判断されたケースもあります。現行法では法的根拠が曖昧で、警察も判断が難しく、被害者が泣き寝入りせざるを得ないのが実情です」

平成の時代にはアイドルの写真とヌード画像を合成したアイドルコラージュ、通称「アイコラ」が流行し、社会問題となった。当時の状況と生成AIを使用した現在のフェイクポルノとでは、事情が異なる部分もあるという。

「アイコラは加工に専用のソフトや技術が必要で、大量生産が難しかった。今はスマホ1つ、写真1枚から誰でも簡単にヌード画像や動画、音声までも生成でき、『剥ぎコラ』といって背景をそのままに被写体だけをヌードにすることも可能です。『1枚いくらで裸に加工します』など、フェイクポルノによる性的コンテンツがビジネスとなっている一方で、あまりに簡単に誰でも作れてしまうので、もはや売買自体が下火となっているプラットフォームもあるほど。ネットに拡散せず個人で生成して楽しむ範囲では、現行法では全く対処ができません。嫌がらせで本人に送りつける場合は、ストーカー規制法が適用される可能性もありますが、常習性の有無や同姓によるいじめの場合など、現行法の解釈だけでは無理があるケースも多いです」

急増するフェイクポルノ被害には、どう向き合っていくべきなのか。永守さんは表現の自由との兼ね合いも考慮しつつ、法整備に向けた一刻も早い議論の必要性を訴える。

「フェイクポルノは紛れもない人権侵害ですが、学校も警察も判断できない事例を現場に丸投げするのは無理がある。被害に遭った当事者本人と、フェイクポルノかどうかを確認していく作業も必要となりますが、これも二次被害に当たるのではないかと意見が分かれるところです。また、被害者は女性が想定される場合が多いですが、生成AIを悪用して痴漢冤罪(えんざい)の動画を捏造したり、性犯罪者に仕立て上げられるなど、男性にとっても人ごとではありません。選挙期間中に候補者のフェイク動画を撒かれた場合、後から潔癖を証明しても後の祭り。一度棄損された名誉は、完全に回復することは不可能なのです」

国会では先月28日、国内初となるAI法案が閣議決定。悪質な事業者名を公表するなどAIの悪用に対処していく方針だが、技術革新促進の観点から罰則規定などは盛り込まれておらず、専門家からは実効性を疑問視する声も上がっている。

あなたの“気になる”を教えてください

あなたの“気になる”を教えてください